AMD 在這次美國聖荷西舉辦的 AMD Advancing AI 2025 活動中,宣布推出新一代的 Instinct MI350 系列 GPU,並且透過標準化、開放的軟硬體生態系配置,提供更具彈性的 AI 運算效能平台。

AMD 這次在美國加州聖荷西的會議中心舉辦 Advancing AI 2025 活動。

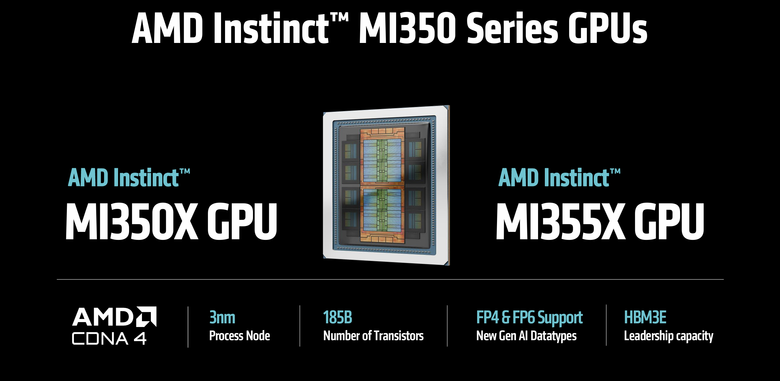

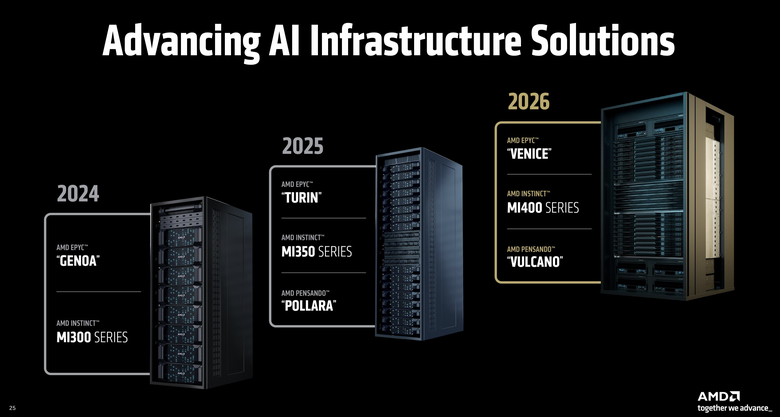

AMD 這幾年持續透過 EPYC 處理器跟 Instinct MI 系列 GPU,以及開放式的架構提供市場上另外一種 AI 基礎設施的解決方案,在硬體的運算能力上也不斷精進,在本周公布的 Top500 超算排行榜中,由 Instinct MI300A APU 所組成的 El Capitan超級電腦以及由 EPYC CPU 和 Instinct MI250X GPU 所組成的 Frontier 就位居一、二名的寶座,在這次於美國聖荷西舉辦的 AMD Advancing AI 2025 活動中,更是依照原有開發路線,推出新一代的 Instinct MI350 系列 GPU,透過 3 奈米節點製程、頻寬更大的 HBM3E 記憶體、新資料格式支援、更好的能源效率與晶片架構,提供標準化以及更具效率的 AI 基礎架構選擇,以下就先以 AMD 官方提供的簡報,來看看這次 Instinct MI350 系列 GPU 的主要特色。

AMD 董事長暨執行長蘇姿丰博士展示了 MI350X 系列 GPU。

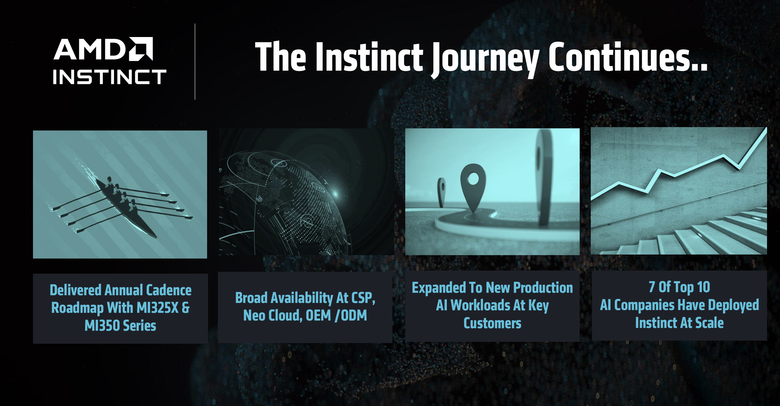

首先來看 AMD 在 Instinct 系列產品的發展策略部分,提供了包括在效能/總持有成本上的領先、跟現有架構更好的整合性、持續保持開性以及更好的客戶支援,在市場上吸引客戶採用。

另外也透過持續規律的產品更新,擴充 Instinct 系列產品在市場上的佔有率,目前在 Top 10 的 AI 公司已經有 7 家採用具規模性的 Instinct 架構。

講到這個當然要列一下名單來表示可信度啦。

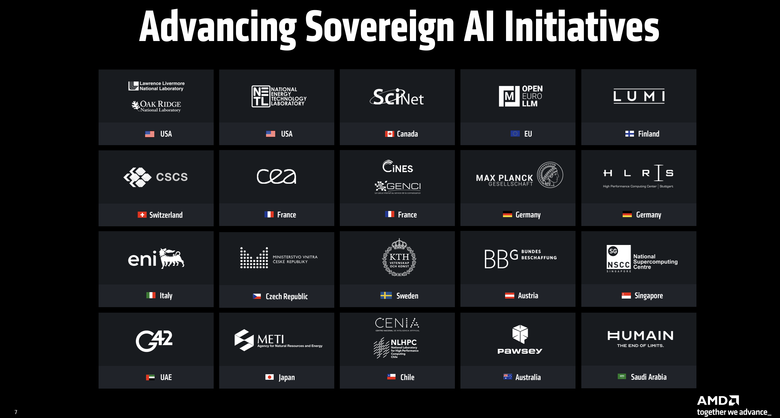

另外在主權 AI 部分,也有相當多國家採用 Instinct 架構來建構自己的 AI 基礎設施。

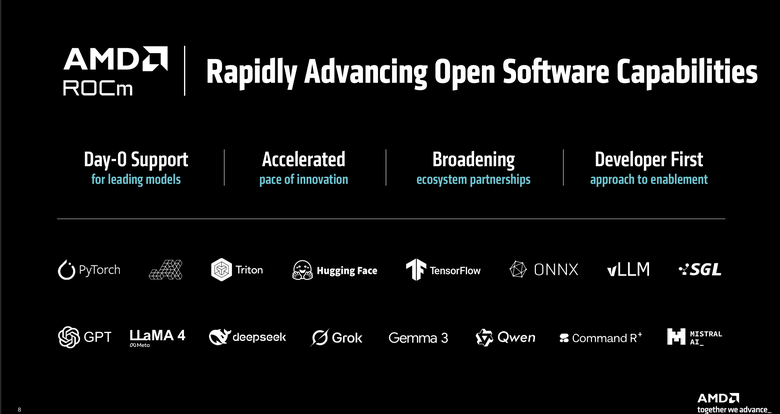

另外在軟體部分則是透過開放的 ROCm 軟體架構提供更多 AI 開發與應用的支援。

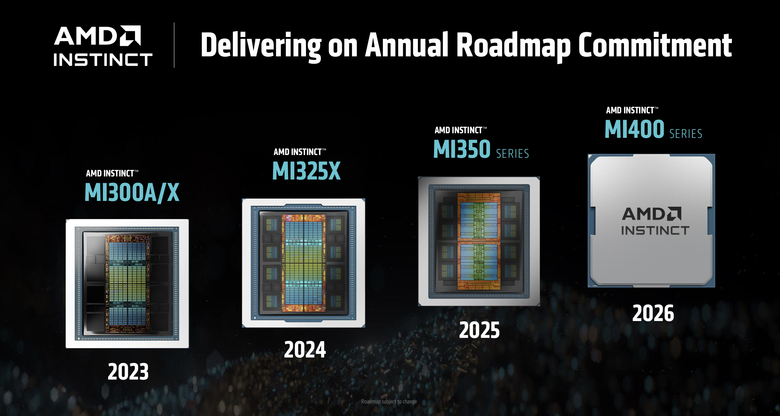

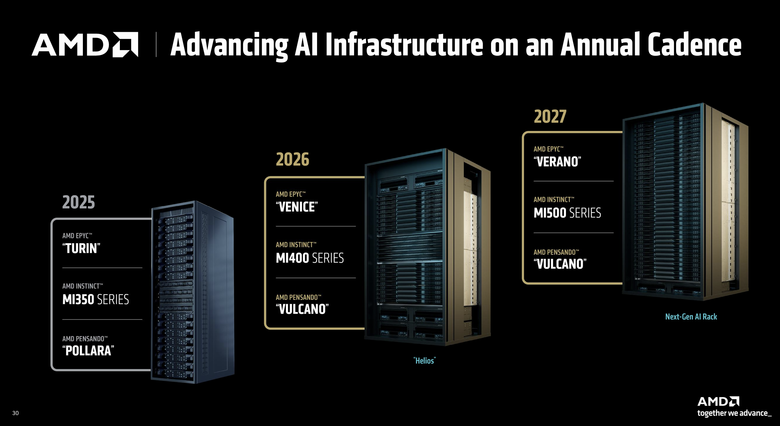

而 Intsinct 系列在硬體更新部分也持續依照先前承諾的進度推出新產品,明年將會推出 MI400 系列 GPU。

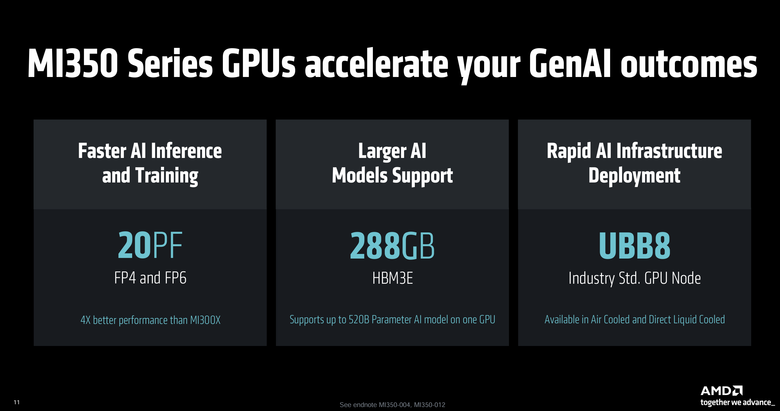

而回到這次發表會的主角:Instinct MI350 系列 GPU,AMD 表示這系列產品將會具備領先的生成式 AI 效能表現。

提供了高達 20 PF(FP4/FP6)的 AI 推論與訓練效能,比起 MI300X 提升至 4 倍。記憶體部分最大支援 288GB 的 HBM3E 記憶體,在單一 GPU 可支援 520B 參數量的 AI 模型運算,並且透過 UBB 標準提供更快速擴展的佈署設計。

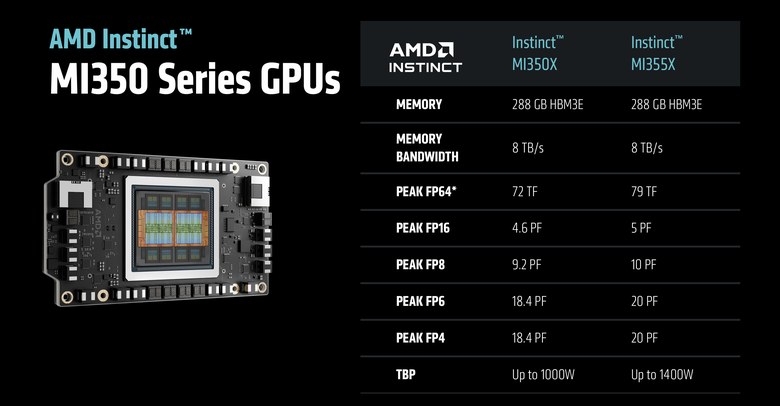

而這次 AMD 在 Instinct MI350 系列共推出 MI350X 以及 MI355X 兩個款式,基本上的規格大致相同,主要在效能上因為功耗配置不同而有些微的調整。

MI350X 與 MI355X 的比較,可以看到 MI350X 在效能上略比 MI355X 設定性能較低一點,在 TBP 功耗上面也是有顯著差異,但若是以效能/功耗比來看, MI350X 會比較有優勢。

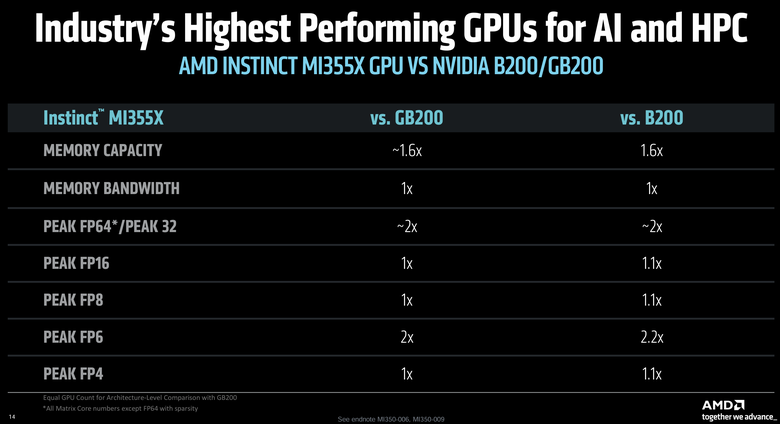

不能免得當然還是要跟競爭對手比一下,跟 GB200/ B200 相比,MI355X 具備更高的記憶體容量、更大的記憶體頻寬、在高精度的 FP64/32 以及 FP6 資料格式下也有 2X 的效能表現。

而在平台架構上,這次 AMD 也提供了空冷以及直接液冷兩種解決方案。

而在平台架構上,這次 AMD 也提供了空冷以及直接液冷兩種解決方案。

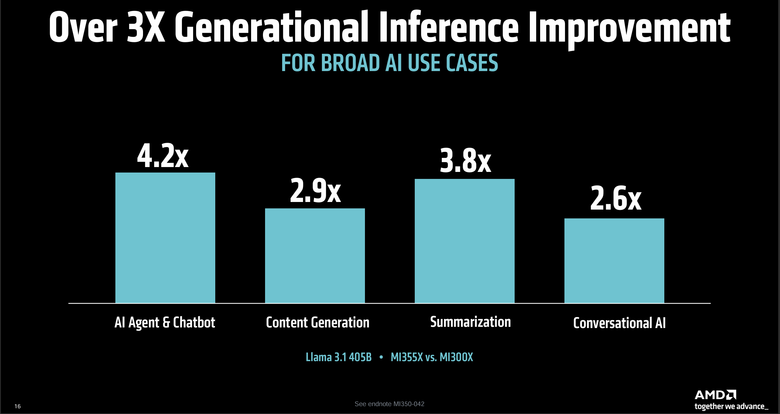

在生成推論的效能表現上,跟 MI300X 相比,MI355X 在 AI 代理/聊天機器人、內容生成、摘要整理、對話式 AI 等應用,在 LIama 3.1 405B 模型中有著 2.6X 至 4.2X 不等的效能提升。

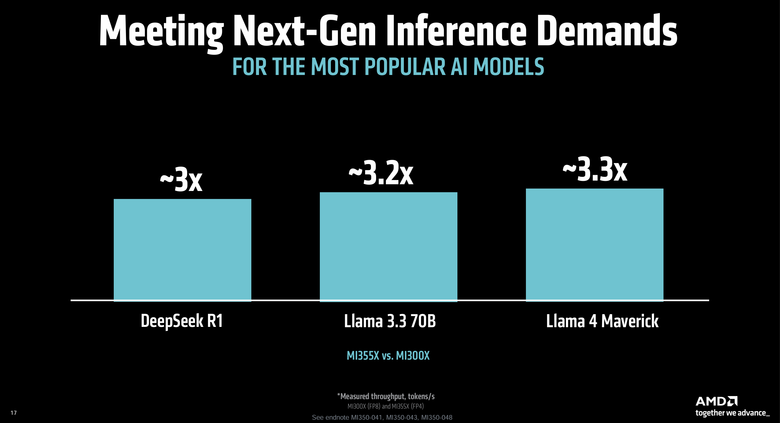

而在針對新模型的支援部分,MI355X 則是透過新的 FP4 資料格式支援,比起使用 FP8 資料格式的 MI300X ,在 DeepSeek R1、Llama 3.3 70B、Llama 4 Maverick 模型中有著 3X 至 3.3 X 的效能提升。

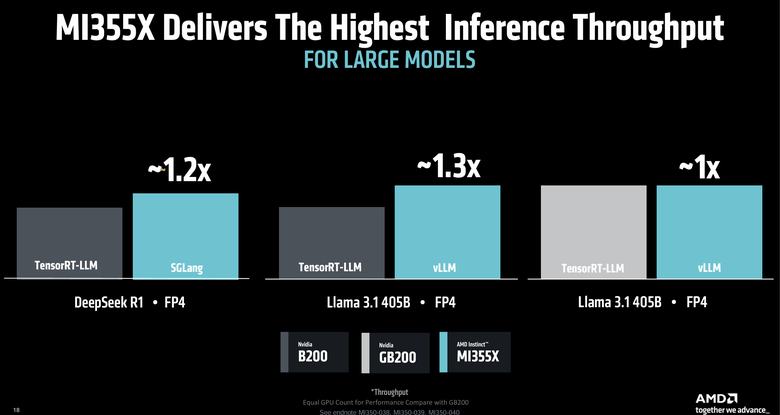

在 Throughput 部分則是比起競爭對手,在 SGLang/vLLM 下與 TensorRT-LLM 相比有著最高 1.3X 的領先。

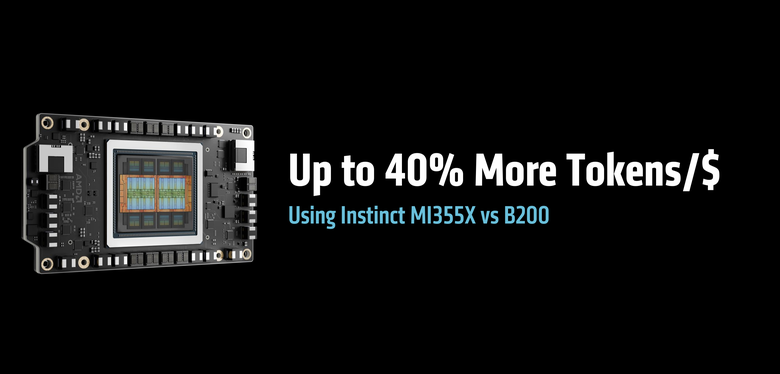

另外在運算的單位成本上,MI355X 比起 B200 每單位成本可以生成多 40% 的 Token,對於採購來說應該相當具有吸引力。

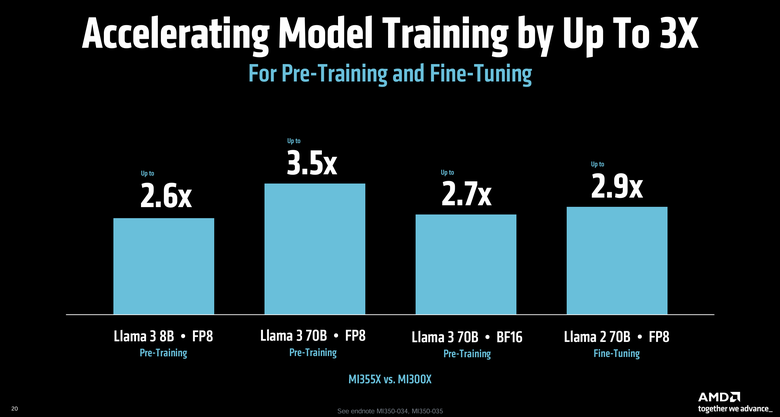

至於在 AI 模型的預先訓練以及微調部分,MI355X 也比 MI300X 有著 2.6X 至 3.5X 不等的效能提升。

至於在 AI 模型的預先訓練以及微調部分,MI355X 也比 MI300X 有著 2.6X 至 3.5X 不等的效能提升。

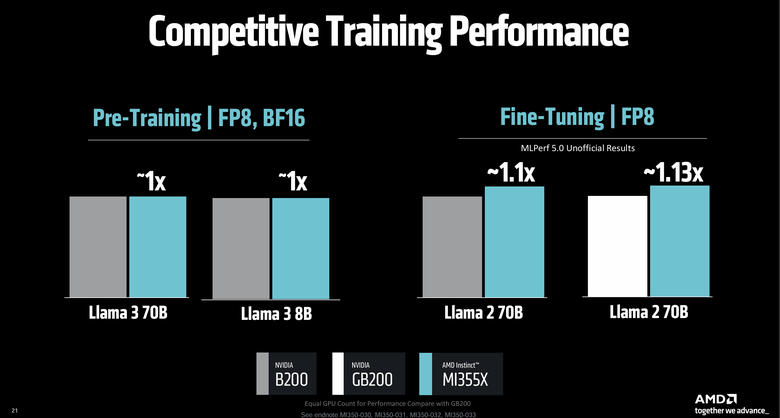

而跟競爭對手相比,在預訓練的部分效能打平,而在 FP8 資料格式下的模型微調部分,則是有 1.1X 至 1.13X 的效能領先。

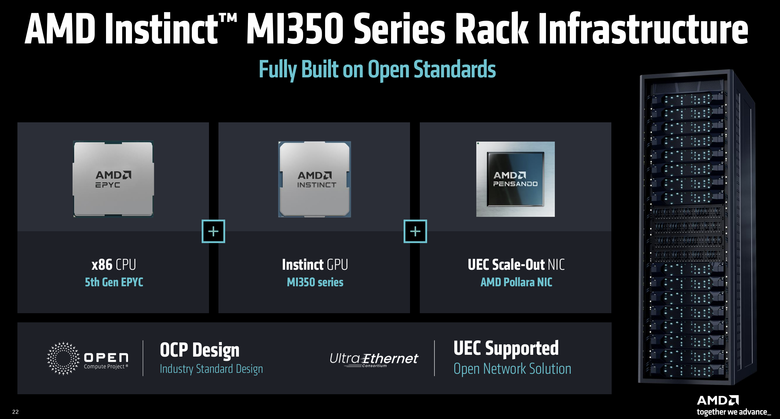

而這次 AMD 透過第五代 EYPC CPU、 Instinct MI350 系列 GPU 以及 Pollara NIC 組成了機架式的基礎架構,並且遵循 OCP 工業標準設計以及支援 UEC 開放網路解決方案,提供採用者更大的擴充彈性。

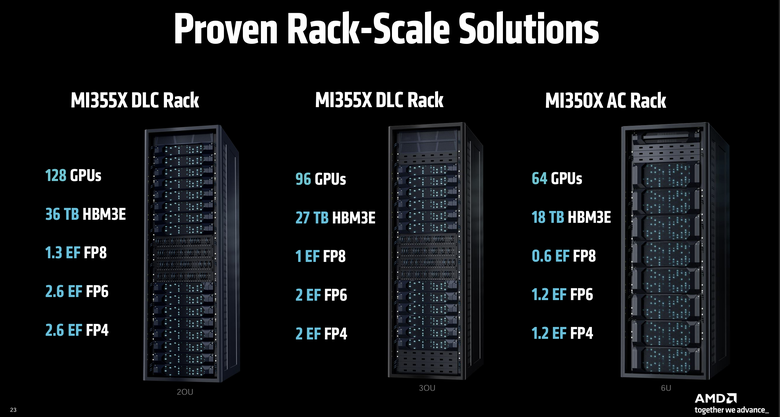

而這次 AMD 也推出了空冷/液冷設計不同的參考配置,提供從 64 GPU 至 128 GPU 不等的機架式解決方案。

目前主要的架構硬體廠商將會在今年 Q3 推出 Instinct MI350 系列的解決方案,台灣廠商包括技嘉、華擎、仁寶、英業達、神達、微星、緯創、雲達等都將推出產品。

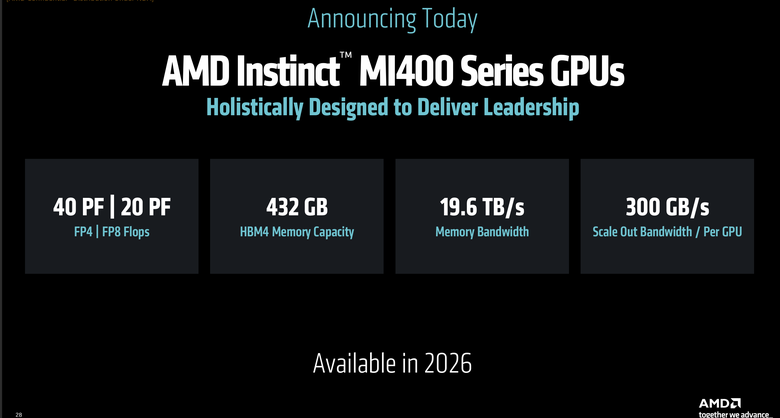

而 AMD 也在這次發表會中先預告了下一代的 AI 基礎架構解決方案,將以新一代的 VENICE EPYC 處理器、MI400 系列 GPU 以及 VULCANO NIC 組成。

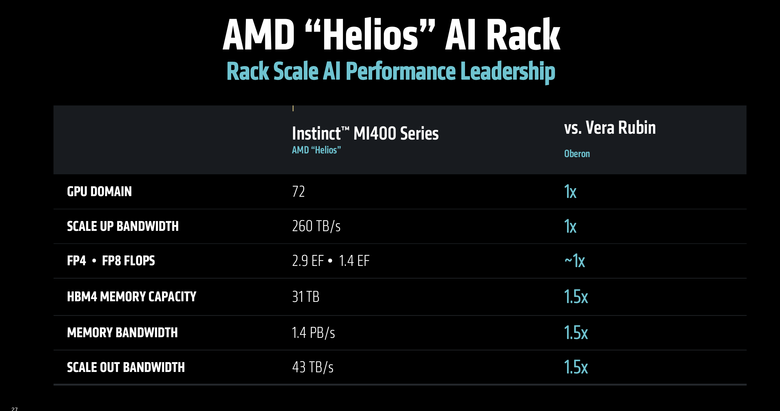

另外也將推出新的 Helios AI 機架設計。

主要提供更大的記憶體容量與頻寬/頻寬擴展性,因應未來資料更大的 AI 模型運算。

當然在上面的圖中,大家也看到了新一代 MI400 系列 GPU 的預告,AMD 在這次活動中也對其性能做出介紹,包括將在 2026 年推出、採用更快/更大容量的 HBM4 記憶體,整體記憶體頻寬來到 19.6 TB/s,在 AI 算力部分則是提供 40PF(FP4)以及 20 PF(FP8)的效能表現。

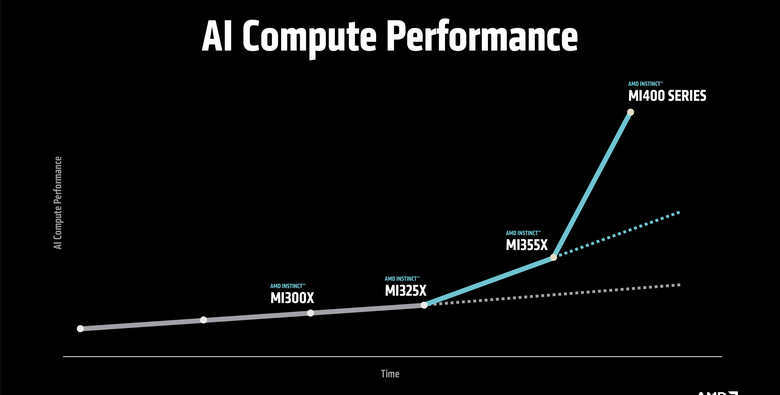

而在 AI 運算效能的成長幅度部分,MI400 系列的效能比起這次發表的 MI350X 系列有 10X 的效能成長。

而到了 2027 年,也將會有更新一代的 VERANO EPYC處理器、MI500 系列 GPU 的組合誕生,實現 AMD 在這部分每年更新的腳步。(不過 AI 服務提供商是否要每年更新硬體,這部分就要看 AI 應用開發的速度,以及整體商業模式/電力供應是否能支撐這樣的擴張/更新腳步了)

感謝分享&介紹,這次AMD帶來滿多話題的

感謝分享&介紹,這次AMD帶來滿多話題的