當時iPhone 12 Pro還在缺貨之際,竟然在Costco官網找到iPhone 12 Pro Max上架,下訂入手至今已經一個多月,還在不斷探尋它的各項潛力,去年Sony和Canon都推出了劃時代的新產品,我還正在猶豫不決當中,如今Apple又來攪局,真是太難決定了。

現在電影圈已經有人用iPhone拍院線片,而且還只是前兩代的舊機種,就能夠讓觀眾買票進電影院,這真是太顛覆傳統認知了!可是iPhone真的有那麼神奇嗎?我手上的一堆單眼相機和鏡頭該如何處理?經過這段期間私下研究所做的結論,單眼相機我還是會繼續拿來拍照,但iPhone則會用來錄影,理由如下:

1. 單眼相機拍攝的畫面解析度很高,動輒是2000~6000萬像素一張,但是iPhone尚停留在1200萬,這還是有灌水之嫌的數據,因為手機給相機模組留下的空間,已經決定了感光元件和鏡頭的大小,就是大約全畫幅相機的二十分之一,只有二十分之一的曝光面積,卻產生五分之一的像素,令人懷疑這中間的像素是用更低解析度的原始採樣,塗抹渲染成1200萬像素,它並不是用每一道光線刻畫出來的真實紀錄,所以放大檢視像素就是不夠紮實清晰銳利。

2. 所有手機鏡頭材質都是塑膠製,單眼相機鏡頭都是玻璃製,有些高級品甚至是用螢石,加上多種表面鍍膜,以及鏡頭相差矯正等工藝鑄成。iPhone面對強光時的炫光和鬼影太嚴重,沒辦法為它加上遮光罩,鏡頭邊緣成像變形太明顯,尤其是超廣角那顆拍風景還可以,拍人臉簡直不能看,新手機拿到的興奮感過了之後,光學上的缺陷就看得一清二楚。

3. 手機那麼小的鏡頭把光圈開到最大,約略等於單眼鏡頭常用範圍的最小光圈,注定只適合於光線充足的環境,而且拍不出窄景深的背景虛化效果。但是Apple很努力要把這個天然困境加以突破,所以就用後製的方法加以模擬,把畫面中每個像素進行分析,找出幾個動態範圍近似的區域,例如天空、草地、人臉、頭髮等,然後分離出背景和主題兩個圖層,將背景圖層進行模糊虛化,創造窄景深的假像。

這種後製過的照片用螢幕放大檢視,在圖層邊界地帶會有破綻,例如髮絲就很難分離乾淨。如果是拍攝高速移動主題,例如小孩、寵物或車輛,HDR連拍多張照片期間主體已經位移,疊圖處理可能會套不齊融合不起來。夜景模式會主動將噪點抹去,但抹去過程可能會將現場訊息一併消除。手機超廣角、廣角、望遠明明是三顆定焦鏡,卻用軟體模擬出數碼變焦效果,介於兩焦段之間的畫質劣化明顯。總之手機拍照只能宏觀不能細看,重要時刻單眼才是紀錄永恆瞬間的利器。

4. 手機的感光元件太小不適合拍照但卻適合錄影,因為影片的每個單格畫面解析度本來就很小,1080P已成今日標準,4K則方興未艾,1080P單格畫面約200萬像素,4K單格畫面約800萬像素,我估計iPhone的真實解析度介於兩者之間,應付當前的錄影需求還算可以。

拍攝影片的資料流量很大,要靠硬體即時壓縮和解壓縮才能順暢,這點恰好是Apple的強項,因為它的SoC業界最強,支援10 bit色深度的Dolby Vision錄影格式,蘋果深知感光元件的面積是它無法跨越的障礙,所以要善用每個像素的紀錄能力,iPhone 12集拍攝、播放、剪接能力於一身,既無風扇也不會過熱當機,直接在手機上媲美專業攝影機,這是前所未聞破天荒超豪華的創舉。

Dolby Vision是一個目前當紅的12 bit色彩標準,12 bit是指RGB三原色中任何一色皆用12 bit來紀錄,每一個像素其實是用36 bit來紀錄,共可產生2的36次方68,719,476,736種顏色變化,至少要4000 nits以上的頂級螢幕才能顯示,可是蘋果那台要價16萬台幣的32吋Pro Display XDR也才顯示10 bit而已,亮度約1000 nits,一般規格大多顯示8 bit,亮度在400~600 nits之間,普通廉價螢幕則低至100 nits,為何Dolby Vision要訂出一個市場無人能及的超高標準?

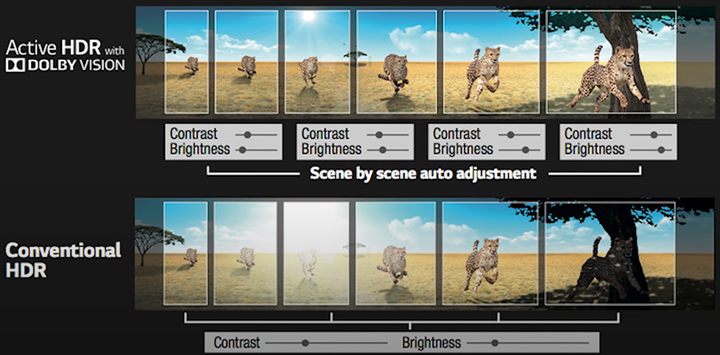

首先它是屬於HDR的一種技術,把元數據進行動態調整(Dynamic Metadata),一張照片拍不出所有細節,那我們就拍很多張不同曝光量(EV值)的照片,把所有最棒的部分拼湊起來。換成影片概念也是一樣,好萊塢的電影膠卷畫質是最棒的,必須要用12 bit的動態範圍才能完整收錄所有色彩,但是家裡的電視只有8 bit,有時候畫面黑蒙蒙或白茫茫一片,我們經常要調整亮度和對比,Dolby Vision認證的電視裡面會有一顆晶片,它根據目前影片的色彩區間隨時調整亮度和對比,速度是每一格畫面調整一次,最新版的Dolby Vision IQ還會把環境光納入考量,依據室內明亮程度自動加權調整,就樣就能輕鬆看清每個場景的所有細節。(請參閱以下附圖實例)

5. iPhone 12 Pro Max有一項秘密武器,由於它外觀上螢幕尺寸最大(6.7吋),因此便有多出的內部空間,將位於機背的主鏡頭感光元件面積增大47%,並且裝設位移式光學影像穩定器,也就是通稱的機身防抖功能,這對於微光情境增加進光量和改善晃動有幫助,但最棒的是在全天候拍攝錄影的時候,減少影像晃動的視覺干擾效果顯著。

6. 和iPhone 12 Pro版本共享的另一項黑科技,就是機背新增LiDAR光學雷達,用雷射測距儀來進行夜間對焦,雖然有效距離只有五公尺,但是在伸手不見五指的情境非常有用,這個LiDAR是源自Face ID的較低解析度版本,因為它主要目的是輔助測距,不是描繪人臉五官細節。

我對於Dolby Vision的拍攝畫質充滿期待,也很好奇降轉成8 bit之後的品質,Mac版的官方軟體iMovie和Final Cut Pro都已支援剪輯和轉檔,趁假日全家外出踏青時讓女王負責掌鏡,我和兒子每人一台單眼進行畫質比較,結果三台全輸iPhone,可能是我的單眼機型老舊所致,但如今我也沒動力更新了。

https://youtu.be/BlsfXH8emXU